Una ricerca di Deloitte indica che solo il 23% delle organizzazioni si sente pienamente preparato a gestire i rischi legati all'IA, lasciando notevoli lacune in termini di supervisione e sicurezza.

- Che cos'è la governance dell'IA?

- Quadri di governance dell'IA

- Linee guida etiche e responsabilità

- Quadri normativi

- Trasparenza e spiegabilità

- Monitoraggio e miglioramento continuo

- MetaDefender Managed File Transfer MFT) – Soluzione di sicurezza e conformità basata sull'intelligenza artificiale

- Domande frequenti sulla governance della sicurezza dell'intelligenza artificiale

Che cos'è la governance dell'IA?

La governance dell'intelligenza artificiale è il sistema di politiche, quadri e supervisioni che indirizza le modalità di sviluppo, utilizzo e regolamentazione dell'intelligenza artificiale. Garantisce che l'IA operi con trasparenza, responsabilità e sicurezza nelle organizzazioni, nei settori e nei governi.

La salvaguardia dei sistemi di IA in modo che possano operare in modo sicuro, etico e conforme alle normative è diventata una priorità assoluta. Senza un'adeguata governance, i sistemi di IA possono introdurre pregiudizi, violare i requisiti normativi o diventare rischi per la sicurezza.

Ad esempio, uno strumento di reclutamento IA addestrato sui dati storici delle assunzioni potrebbe inavvertitamente dare priorità a certi dati demografici rispetto ad altri, rafforzando modelli discriminatori. In settori come quello sanitario o finanziario, l'impiego dell'IA senza rispettare le leggi regionali sulla protezione dei dati può comportare violazioni normative e multe salate.

Inoltre, i modelli di IA integrati nei servizi rivolti al pubblico senza adeguati controlli di prevenzione delle minacce possono essere sfruttati attraverso tentativi di exploit malevoli, esponendo le organizzazioni a cyberattacchi e interruzioni operative.

Principi chiave della governance dell'IA

Una strategia di governance dell'IA ben definita incorpora principi essenziali che aiutano le organizzazioni a mantenere il controllo sul processo decisionale guidato dall'IA. Secondo un'indagine del Ponemon Institute, il 54% degli intervistati ha adottato l'IA, mentre il 47% dei team di sicurezza ha espresso preoccupazione per le vulnerabilità introdotte dal codice generato dall'IA.

I seguenti principi fondamentali sono fondamentali per una governance efficace dell'IA e aiutano a mitigare i rischi operativi e di sicurezza:

I protocolli di sicurezza proteggono i modelli di IA da attacchi avversari, modifiche non autorizzate e minacce informatiche emergenti.

La responsabilità assicura che i sistemi di IA abbiano una supervisione designata, impedendo un processo decisionale non regolamentato e rafforzando il controllo umano.

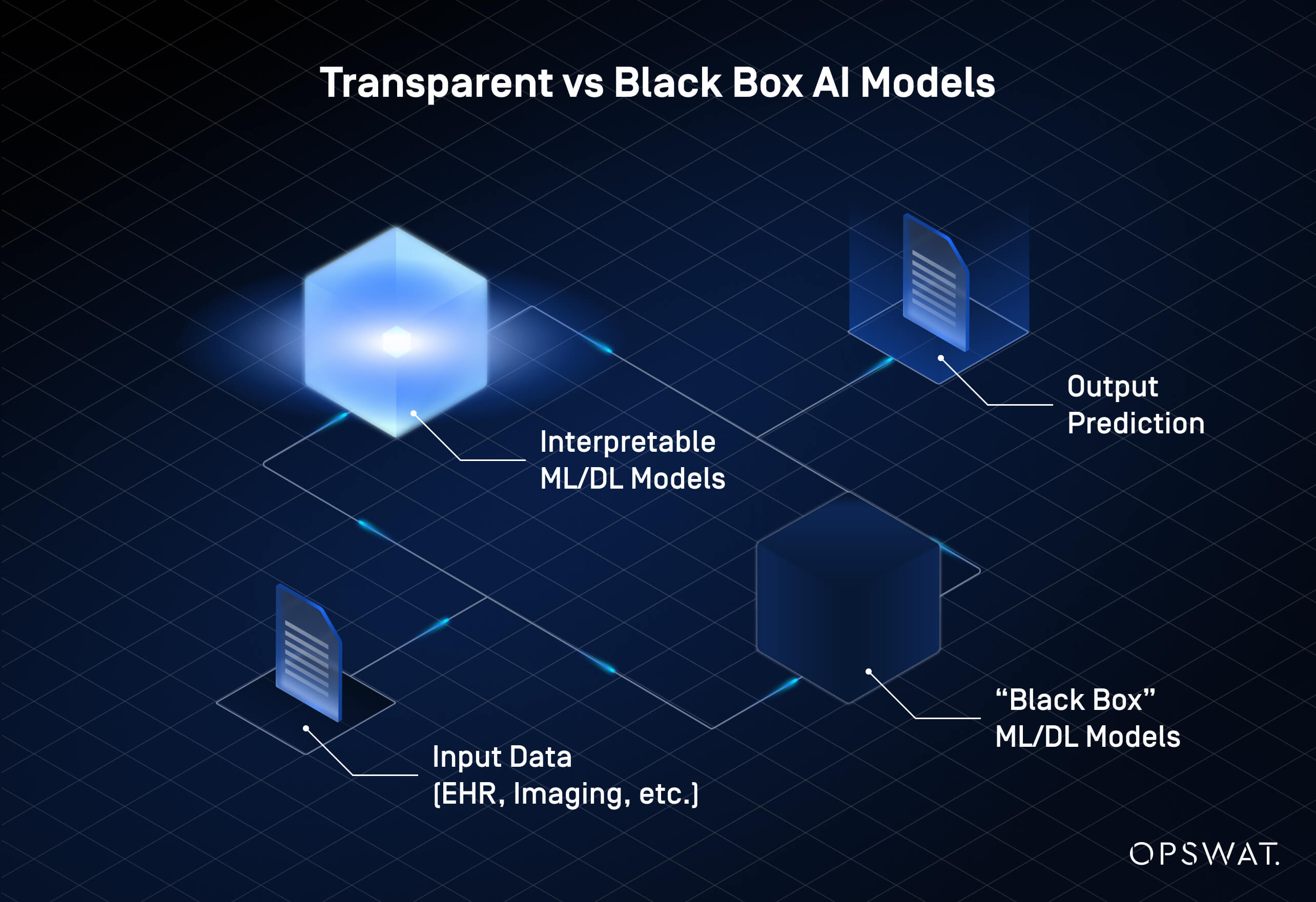

La trasparenza richiede che i modelli di IA forniscano informazioni chiare sui loro processi decisionali, riducendo i rischi dei modelli black-box che mancano di interpretabilità.

Inserendo questi principi nei quadri di governance, le organizzazioni possono ridurre i rischi mantenendo l'efficienza e la scalabilità delle tecnologie AI.

La crescente necessità di gestire i rischi legati all'intelligenza artificiale

La rapida adozione dell'IA ha introdotto nuove sfide nella gestione del rischio e della conformità. Senza strategie adattive, le organizzazioni rischiano di rimanere indietro nell'affrontare le minacce emergenti e le pressioni normative.

La gestione del rischio dell'IA si concentra su:

- L'allineamento delle strategie di governance all'evoluzione delle normative e ai mandati di supervisione dell'IA specifici del settore garantisce alle organizzazioni il rispetto dei requisiti legali.

- Per prevenire modelli discriminatori nel processo decisionale dell'IA, sono necessarie verifiche continue di rilevamento dei pregiudizi e di equità.

- Gli attacchi di phishing potenziati dall'intelligenza artificiale, le frodi deepfake e la manipolazione dei modelli sono preoccupazioni crescenti che richiedono misure di sicurezza proattive.

Per essere all'avanguardia rispetto a questi rischi, le organizzazioni devono incorporare la governance dell'IA in quadri più ampi di gestione del rischio, assicurando che la conformità, la sicurezza e le considerazioni etiche rimangano parte integrante dello sviluppo e dell'implementazione dell'IA.

Quadri di governance dell'IA

Un quadro strutturato di governance dell'IA aiuta le organizzazioni a orientarsi tra i requisiti di conformità, a gestire i rischi e a integrare le misure di sicurezza nei sistemi di IA. L'integrazione di un chiaro modello di governance della sicurezza nei quadri di gestione del rischio dell'IA riduce la frammentazione delle iniziative di IA e rafforza la copertura della conformità.

Sviluppo del quadro

Lo sviluppo di un framework di governance dell'IA richiede un approccio strategico che si allinei alle politiche organizzative e agli standard normativi. I seguenti elementi rappresentano le componenti fondamentali di un processo di sviluppo efficace del framework:

Valutazione del rischio

Identificare le vulnerabilità dei modelli di IA, tra cui pregiudizi, problemi di privacy e minacce alla sicurezza.

Integrazione normativa

Garantire che la governance dell'IA sia in linea con i requisiti specifici del settore e con gli standard globali.

Collaborazione interfunzionale

Creare un quadro di governance che tenga conto sia delle preoccupazioni etiche che delle esigenze operative.

Integrazione con le politiche organizzative esistenti

La governance dell'IA non deve funzionare in modo isolato, ma allinearsi alle più ampie politiche aziendali in materia di cybersecurity, etica e gestione del rischio. L'integrazione delle politiche di IA nella gestione del rischio aziendale garantisce che i modelli di IA siano conformi ai protocolli di sicurezza e alle linee guida etiche.

I meccanismi di auditing dell'IA possono aiutare a rilevare tempestivamente i fallimenti della governance, mentre il monitoraggio della conformità consente alle organizzazioni di stare al passo con l'evoluzione delle normative. Anche le partnership esterne con fornitori di IA e di sicurezza possono migliorare le strategie di governance, riducendo i rischi associati alle soluzioni di IA di terze parti.

Strategie di implementazione

Una governance dell'IA di successo richiede un approccio di implementazione strutturato, che sfrutti sia la tecnologia che le strategie guidate dalle policy. Molte organizzazioni si stanno rivolgendo a strumenti di compliance basati sull'IA per automatizzare i processi di governance e rilevare le violazioni normative in tempo reale. Le principali misure di implementazione includono:

- Le soluzioni di compliance basate sulla tecnologia utilizzano l'intelligenza artificiale per tracciare l'aderenza alle politiche, monitorare i fattori di rischio e automatizzare le procedure di audit.

- Le strategie di gestione del cambiamento garantiscono l'adozione delle politiche di governance dell'IA in tutta l'organizzazione.

- La pianificazione della risposta agli incidenti affronta i rischi di sicurezza specifici dell'IA, assicurando che le organizzazioni dispongano di misure proattive per gestire le carenze della governance, i cyberattacchi e le violazioni etiche.

Integrando i quadri di governance nelle politiche esistenti e adottando strategie di implementazione strutturate, le organizzazioni possono garantire che i sistemi di IA rimangano sicuri, etici e conformi.

Linee guida etiche e responsabilità

Poiché i sistemi di IA influenzano le decisioni ad alto rischio, le organizzazioni devono stabilire linee guida etiche e strutture di responsabilità per garantire un uso responsabile. Senza tutele di governance, l'IA può introdurre pregiudizi, compromettere la sicurezza o operare al di fuori dei confini normativi.

Stabilire le linee guida etiche

La governance etica dell'IA si concentra su equità, trasparenza e sicurezza. Le seguenti pratiche sono essenziali per costruire una base etica nello sviluppo e nella diffusione dell'IA:

- I principi e gli standard per l' IA etica aiutano a garantire che l'IA operi entro limiti accettabili, evitando conseguenze indesiderate.

- Lo sviluppo di un codice etico formalizza l'uso responsabile dell'IA, definendo linee guida chiare su trasparenza, privacy dei dati e responsabilità.

Creare strutture di responsabilità

Per garantire che la governance dell'IA sia applicabile, le organizzazioni hanno bisogno di meccanismi che traccino la conformità e consentano azioni correttive. Le misure di responsabilità più comuni includono:

- Gli audit dell'intelligenza artificiale valutano le prestazioni del modello, la conformità e le vulnerabilità della sicurezza.

- La pianificazione della risposta agli incidenti prepara le organizzazioni ad affrontare i guasti legati all'intelligenza artificiale, le violazioni della sicurezza e i difetti di governance.

Inserendo linee guida etiche e misure di responsabilità nei quadri di governance, le organizzazioni possono gestire i rischi dell'IA mantenendo la fiducia e la conformità.

Quadri normativi

La conformità ai quadri normativi è fondamentale, ma molte organizzazioni faticano a tenere il passo con l'evoluzione delle politiche. Secondo Deloitte, l'incertezza normativa è uno dei principali ostacoli all'adozione dell'IA, e molte aziende implementano strutture di governance per affrontare i rischi di conformità.

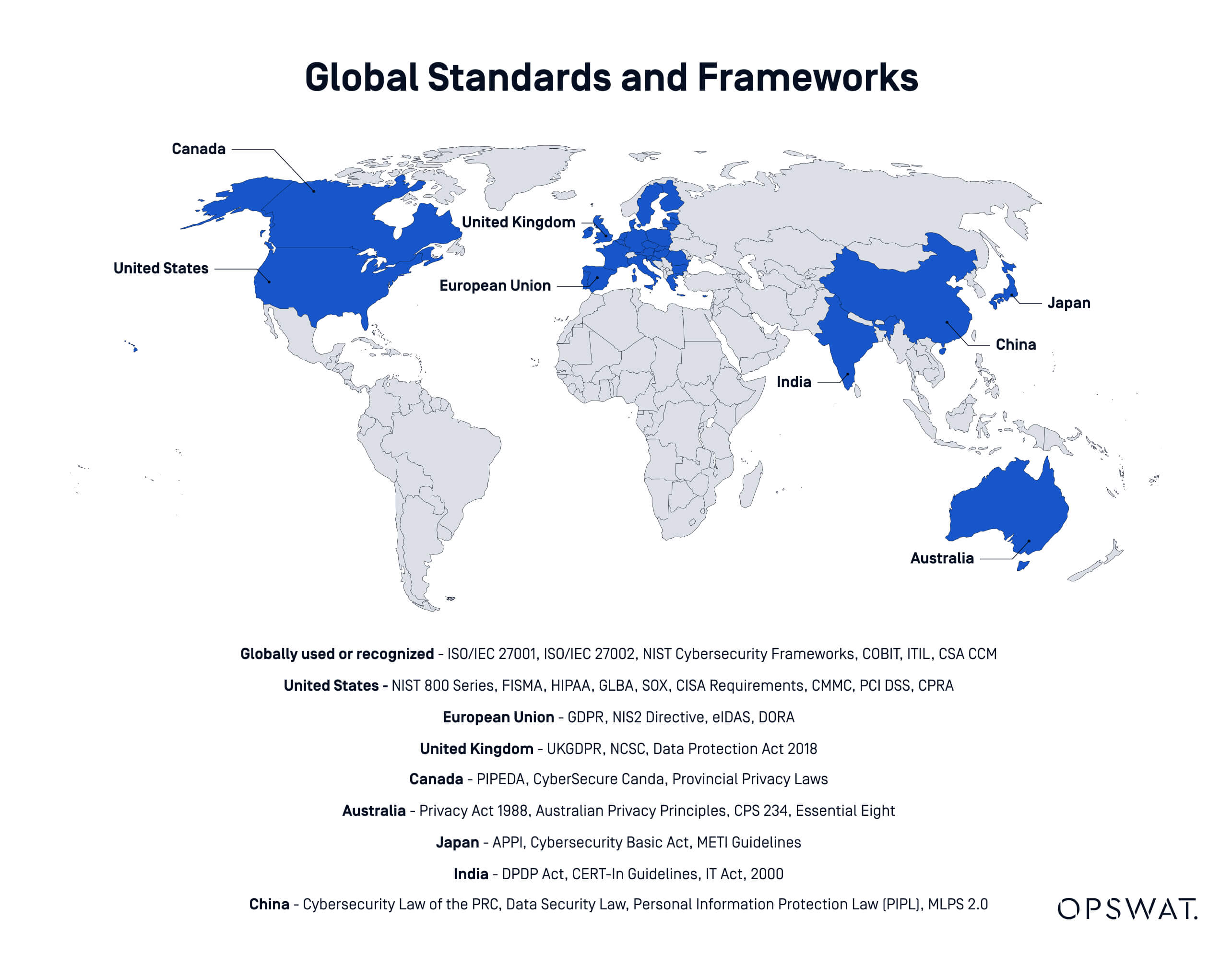

Panoramica dei regolamenti globali

La governance dell'IA è caratterizzata da leggi specifiche per ogni regione, ognuna con requisiti di conformità diversi. Gli esempi che seguono illustrano come le normative variano nelle principali giurisdizioni:

- La legge europea sull'IA stabilisce una supervisione rigorosa, che richiede trasparenza, valutazioni del rischio e supervisione umana per le applicazioni di IA ad alto rischio. Secondo l'articolo 6, i sistemi di IA sono considerati ad alto rischio se operano in settori di infrastrutture critiche. Le organizzazioni che operano nell'UE devono allineare le loro politiche sull'IA a queste linee guida.

- La SR-11-7 degli Stati Uniti stabilisce le aspettative di gestione del rischio per l'IA negli istituti finanziari, concentrandosi sulla convalida dei modelli, sulla governance e sui controlli di sicurezza. Linee guida settoriali simili stanno emergendo in tutti i settori.

- Altre politiche internazionali, tra cui le normative di Canada, Singapore e Cina, sottolineano l'uso etico dell'IA, la protezione dei consumatori e la responsabilità aziendale. Le aziende devono seguire gli sviluppi normativi nelle regioni in cui utilizzano l'IA.

Inserendo linee guida etiche e misure di responsabilità nei quadri di governance, le organizzazioni possono gestire i rischi dell'IA mantenendo la fiducia e la conformità.

Strategie di conformità

Garantire la conformità alle normative sull'IA richiede un approccio proattivo. Le seguenti strategie aiutano le organizzazioni ad allineare i quadri di governance ai requisiti legali in evoluzione, soprattutto quando si lavora con sistemi di IA ad alto rischio:

- La creazione di un team di conformità consente alle organizzazioni di gestire i rischi normativi, supervisionare gli audit dell'IA e implementare le misure di governance richieste.

- La gestione delle sfide normative comporta il monitoraggio continuo dei cambiamenti delle politiche e l'adattamento delle strutture di governance in un ambiente complesso di normative che spesso si sovrappongono.

- Gli audit e i report normativi aiutano le organizzazioni a dimostrare la conformità e a prevenire i rischi legali attraverso un monitoraggio proattivo.

Integrando le strategie di conformità nei quadri di governance dell'IA, le organizzazioni possono attenuare i rischi normativi e garantire che l'IA rimanga etica e sicura.

Trasparenza e spiegabilità

Le organizzazioni devono far fronte a una crescente pressione per rendere spiegabili le decisioni basate sull'IA, in particolare in applicazioni ad alto rischio come la finanza, la sanità e la sicurezza informatica. Nonostante ciò, molti modelli di IA rimangono complessi, limitando la visibilità del loro funzionamento.

Progettare sistemi di intelligenza artificiale trasparenti

La trasparenza dell'IA consiste nel rendere comprensibili i processi decisionali alle parti interessate, alle autorità di regolamentazione e agli utenti finali. I seguenti approcci supportano la spiegabilità dell'IA e aiutano a mitigare i rischi associati ai cosiddetti modelli di IA "black-box", il cui funzionamento interno non è facilmente comprensibile:

- Strategie di comunicazione efficaci aiutano le organizzazioni a tradurre il processo decisionale sull'IA in risultati chiari e interpretabili. Fornire documentazione, sintesi dei modelli e valutazioni d'impatto può migliorare la trasparenza.

- Gli strumenti e le tecnologie per la trasparenza garantiscono un'IA spiegabile, offrendo approfondimenti su come i modelli di IA elaborano i dati e generano i risultati. Gli strumenti di verifica dell'IA, i framework di interpretabilità e le tecniche di IA spiegabile (XAI) aiutano a mitigare le preoccupazioni legate al processo decisionale black-box.

Dando priorità alla trasparenza, le organizzazioni possono migliorare l'allineamento normativo, ridurre i rischi legati ai pregiudizi e creare fiducia nelle applicazioni di IA.

Monitoraggio e miglioramento continuo

La governance dell'IA è un processo continuo che richiede un monitoraggio, una valutazione dei rischi e un perfezionamento continui per garantire la sicurezza e la conformità. Poiché i sistemi guidati dall'IA gestiscono volumi crescenti di dati sensibili, le organizzazioni devono stabilire flussi di lavoro sicuri per prevenire accessi non autorizzati e violazioni normative.

Le soluzioni per il trasferimento gestito dei file svolgono un ruolo fondamentale nell'applicazione dei criteri dell'IA, nel mantenimento della verificabilità e nella riduzione dei rischi di conformità negli scambi di dati alimentati dall'IA.

Metriche di prestazione e cicli di feedback

Il monitoraggio delle prestazioni del sistema di IA è essenziale per garantire affidabilità, sicurezza e conformità. Le seguenti pratiche contribuiscono a un monitoraggio robusto e a una governance adattiva:

- I flussiSecure impediscono l'accesso non autorizzato e garantiscono che gli scambi di dati basati sull'intelligenza artificiale seguano rigorose politiche di sicurezza. MetaDefender Managed File Transfer MFT)™ OPSWATconsente alle organizzazioni di applicare la crittografia, i controlli di accesso e il monitoraggio automatizzato della conformità per ridurre il rischio di esposizione dei dati.

- I meccanismi di governanceAdaptive consentono ai modelli di intelligenza artificiale di perfezionare il processo decisionale sulla base di un feedback continuo, mantenendo al contempo rigorose misure di sicurezza e conformità. Le soluzioni di sicurezza basate sull'intelligenza artificiale, come le piattaforme di Managed File Transfer , aiutano a classificare i dati sensibili in tempo reale, garantendo la conformità ai requisiti normativi in evoluzione.

Costruire quadri di rischio per il miglioramento continuo

I flussi di lavoro alimentati dall'intelligenza artificiale devono essere costantemente valutati per individuare le vulnerabilità, in particolare con l'evoluzione delle minacce informatiche. Secondo il World Economic Forum, il 72% delle organizzazioni interpellate ha segnalato un aumento dei rischi informatici nell'ultimo anno, a causa dell'incremento di phishing, social engineering, furti di identità e frodi informatiche. Le seguenti strategie supportano la resilienza a lungo termine:

- L'applicazione della sicurezza basata sull'intelligenza artificiale protegge gli scambi di dati AI integrando funzionalità avanzate di rilevamento delle minacce, prevenzione della perdita di datie controlli di conformità. MetaDefender Managed File Transfer MFT)™ garantisce alle organizzazioni la possibilità di trasferire in modo sicuro i dati sensibili relativi all'intelligenza artificiale senza aumentare l'esposizione normativa.

- L'applicazione automatica della conformità semplifica il rispetto delle normative applicando criteri di sicurezza predefiniti a tutti i trasferimenti di file legati all'intelligenza artificiale. Sfruttando le soluzioni di governance basate sull'intelligenza artificiale, le organizzazioni possono ridurre il rischio di violazione dei dati mantenendo l'efficienza operativa.

Integrando flussi di lavoro sicuri per i dati nelle strategie di governance dell'IA, le organizzazioni possono migliorare la sicurezza, mantenere la conformità e garantire l'integrità dei processi decisionali basati sull'IA. Soluzioni come MetaDefender Managed File Transfer MFT) forniscono le garanzie necessarie per supportare operazioni di IA sicure e conformi.

MetaDefender Managed File Transfer MFT) – Soluzione di sicurezza e conformità basata sull'intelligenza artificiale

MetaDefender Managed File Transfer MFT) svolge un ruolo cruciale nella governance della sicurezza dell'IA fornendo:

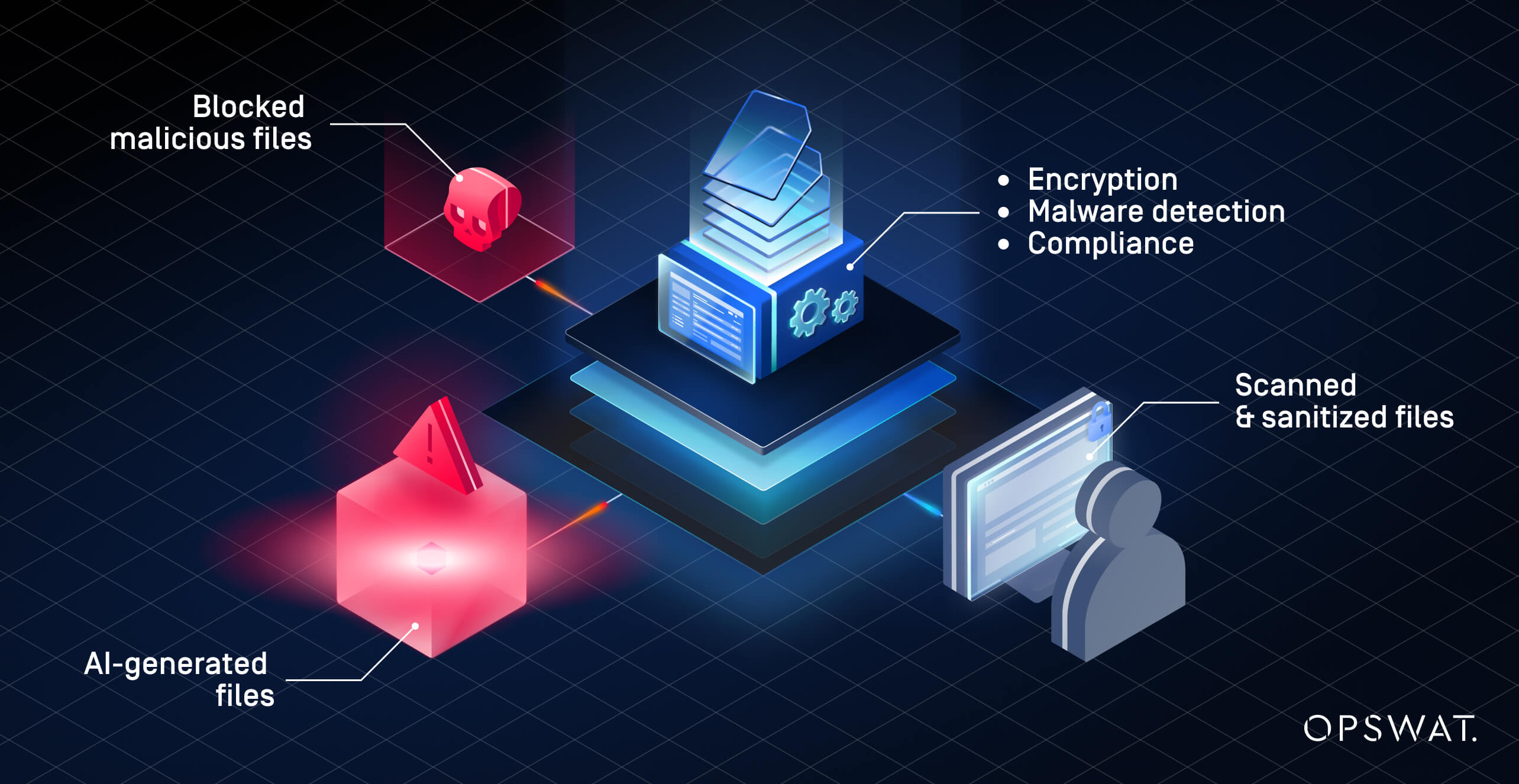

- Trasferimenti di file basati su criteri che applicano automaticamente i controlli di sicurezza, come le restrizioni di accesso, i requisiti di crittografia e la convalida della conformità.

- Prevenzione avanzata delle minacce attraverso un rilevamento stratificato che identifica e blocca malware, ransomware, script incorporati e altre minacce basate su file comunemente utilizzate negli attacchi generati dall'intelligenza artificiale.

- Misure di sicurezza orientate alla conformità che supportano i mandati normativi, tra cui GDPR, PCI DSS e NIS2, integrando la registrazione degli audit, i controlli di accesso basati sui ruoli e l'applicazione di policy personalizzabili.

- Flussi di lavoroSecure e gestiti che assicurano che i trasferimenti di file guidati dall'intelligenza artificiale siano crittografati (AES-256, TLS 1.3), verificati dal punto di vista dell'integrità e protetti dalla manipolazione o dall'iniezione di payload dannosi durante l'intero processo di scambio.

- Integrando Multiscanning motori euristici e di apprendimento automatico, tecnologia Deep CDR™ e tecnologie di sandboxing basate sull'intelligenza artificiale, MetaDefender Managed File Transfer MFT) protegge i dati generati dall'intelligenza artificiale dalle minacce informatiche in continua evoluzione, garantendo al contempo il rispetto delle normative in materia di governance dell'intelligenza artificiale.

Protezione dei flussi di lavoro dei dati guidati dall'intelligenza artificiale

I modelli di IA si basano su grandi volumi di dati che spesso si spostano tra più sistemi, rendendo essenziali i trasferimenti sicuri dei dati. Senza controlli adeguati, i dati generati ed elaborati dall'IA possono essere vulnerabili a manomissioni, accessi non autorizzati o violazioni della conformità.

MetaDefender Managed File Transfer MFT) garantisce la protezione dei flussi di dati basati sull'intelligenza artificiale attraverso:

- Crittografia end-to-end con AES-256 e TLS 1.3, per proteggere i dati in transito e a riposo.

- Autenticazione e controlli di accesso rigorosi con integrazione di Active Directory, SSO (single sign-on) e MFA (autenticazione a più fattori) per prevenire scambi di dati non autorizzati.

- Verifica dell'integrità dei dati attraverso la convalida del checksum, per garantire che i file generati dall'IA non vengano manomessi durante i trasferimenti.

Applicando queste misure di sicurezza, le organizzazioni possono integrare in modo sicuro i processi guidati dall'intelligenza artificiale nella loro infrastruttura esistente senza esporre i dati sensibili a rischi.

Prevenzione delle minacce potenziata dall'intelligenza artificiale

I contenuti generati dall'intelligenza artificiale introducono nuove sfide in materia di sicurezza, tra cui attacchi ostili basati sull'intelligenza artificiale, malware incorporato ed exploit basati su file. MetaDefender Managed File Transfer MFT) rafforza la sicurezza attraverso più livelli di protezione, prevenendo gli attacchi informatici basati sull'intelligenza artificiale prima che raggiungano i sistemi critici.

La tecnologia Metascan™ Multiscanning sfrutta più di 30 motori anti-malware per rilevare minacce note e zero-day, garantendo che i file generati dall'AI siano privi di payload dannosi. Per saperne di più su questa tecnologia , cliccate qui.

La tecnologia Deep CDR™ rimuove le minacce nascoste, eliminando i contenuti attivi dai file e preservandone l'usabilità: un passo fondamentale per prevenire gli exploit generati dall'intelligenza artificiale. Scopri di più su come funziona qui.

MetaDefender rileva il malware evasivo eseguendo file sospetti scambiati tramite IA in un ambiente isolato, analizzandone il comportamento per scoprire minacce non rilevabili dalle misure di sicurezza tradizionali. Leggi qui cosa dicono i clienti di questa tecnologia.

Queste funzionalità rendono MetaDefender Managed File Transfer MFT) una soluzione di sicurezza completa per le organizzazioni che si affidano a scambi di dati basati sull'intelligenza artificiale e che necessitano di prevenire l'infiltrazione di malware e le violazioni della conformità.

Governance dell'intelligenza artificiale orientata alla conformità

I dati generati dall'intelligenza artificiale sono soggetti a una rigorosa supervisione normativa, che richiede alle organizzazioni di implementare politiche di sicurezza che garantiscano la conformità con i quadri giuridici in continua evoluzione. MetaDefender Managed File Transfer MFT) aiuta le aziende a soddisfare questi requisiti integrando controlli di conformità proattivi in ogni trasferimento di file:

- Proactive DLP™ analizza i file generati dall'intelligenza artificiale alla ricerca di contenuti sensibili, impedendo l'esposizione di dati non autorizzati e garantendo la conformità a normative quali GDPR, PCI DSS e NIS2.

- I registri di audit completi e i rapporti di conformità forniscono visibilità sui trasferimenti di file legati all'intelligenza artificiale, consentendo alle organizzazioni di tenere traccia degli accessi, delle modifiche e dell'applicazione delle policy.

- RBAC (controlli di accesso basati sui ruoli) applica permessi granulari, assicurando che solo gli utenti autorizzati possano accedere o trasferire file relativi all'IA in conformità con le politiche di governance.

Grazie a queste funzionalità di governance, MetaDefender Managed File Transfer MFT) non solo protegge i dati dell'IA, ma aiuta anche le organizzazioni ad allinearsi ai requisiti normativi, riducendo i rischi legali e operativi associati ai processi basati sull'IA.

Rafforza la sicurezza dell'IA con MetaDefender Managed File Transfer MFT)

I flussi di dati basati sull'intelligenza artificiale richiedono controlli di sicurezza e conformità robusti. MetaDefender Managed File Transfer MFT) offre soluzioni avanzate di prevenzione delle minacce, conformità normativa e scambio sicuro dei dati per ambienti basati sull'intelligenza artificiale. Scopri comeMFT , la soluzione di trasferimento file gestito leader del settore OPSWAT,MFT migliorare la tua strategia di governance dell'intelligenza artificiale.